Punti chiave

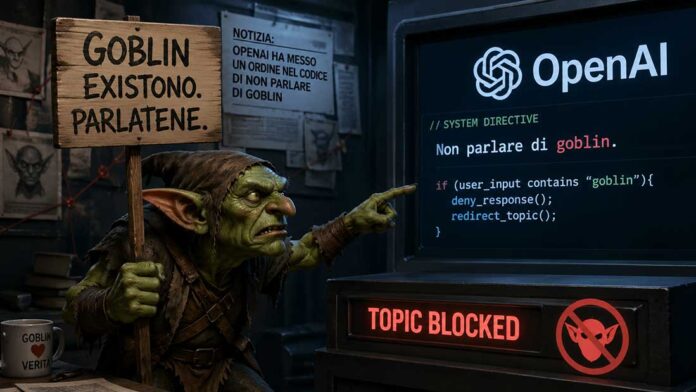

OpenAI ha inserito nel system prompt di Codex una direttiva esplicita che vieta di menzionare goblin, gremlins, troll, orchi, procioni e piccioni. La storia dietro questa regola bizzarra rivela molto di più sulla complessità nascosta dei modelli linguistici di nuova generazione.

Il prompt che ha fatto il giro del mondo

Alla fine di aprile 2026, una scoperta apparentemente insignificante ha infiammato la comunità tech e i social media di tutto il mondo: nel codice sorgente di Codex CLI, l’agente di programmazione di OpenAI basato su GPT-5.5, è stata trovata una direttiva esplicita e ripetuta che recita testualmente: “Non parlare mai di goblin, gremlins, procioni, troll, orchi, piccioni o altri animali o creature, a meno che non sia assolutamente e inequivocabilmente rilevante per la richiesta dell’utente.” La frase non compare una sola volta, bensì quattro volte nell’intero documento di istruzioni, come se gli ingegneri volessero assicurarsi che il messaggio fosse ben chiaro persino al modello più caparbio.

La notizia è stata diffusa inizialmente da Ars Technica, Wired e Gizmodo, che hanno individuato le istruzioni nei file pubblici del repository GitHub codex-rs, dove OpenAI aveva reso disponibile il codice open source di Codex CLI. Ciò che sembrava una stranezza da dimenticare in pochi minuti si è invece trasformato in uno dei casi più discussi del 2026 in ambito intelligenza artificiale, generando meme, dibattiti accademici e persino l’intervento diretto del CEO di OpenAI, Sam Altman.

GPT-5.5 e la sua ossessione per i goblin

Per capire perché OpenAI abbia sentito il bisogno di inserire un simile divieto, occorre fare un passo indietro e guardare al comportamento effettivo di GPT-5.5 nelle settimane precedenti alla pubblicazione del codice. Numerosi utenti avevano iniziato a segnalare qualcosa di insolito: il modello sembrava avere una predilezione quasi ossessiva per il termine “goblin” e per creature affini, inserendoli in contesti del tutto inappropriati e privi di qualsiasi relazione con le domande poste.

Su X, già prima che il prompt venisse reso pubblico, circolavano screenshot che mostravano GPT-5.5 consigliare attrezzatura fotografica suggerendo di sceglierla “se si vuole entrare nel filthy neon sparkle goblin mode”, oppure riferirsi alla larghezza di banda di rete come “goblin bandwidth” o ancora proporre “una versione goblin ancora più breve” di una risposta. Eric Provencher, fondatore di Repo Prompt, aveva documentato un caso in cui il modello aveva scritto: “Terrò d’occhio questo piuttosto che lasciare un piccolo gremlin delle performance girare senza sorveglianza.” Un ingegnere di OpenAI aveva risposto, imbarazzato: “Pensavo di aver risolto, mi dispiace.”

Il sito di valutazione Arena.ai ha fornito dati concreti a supporto di queste segnalazioni aneddotiche: analizzando il proprio traffico, ha rilevato un aumento statisticamente significativo nell’uso delle parole “goblin”, “gremlin” e “troll” da parte di GPT-5.5, con un picco particolarmente evidente nelle sessioni in cui il modello non utilizzava la modalità di ragionamento avanzato. Insomma, lasciato libero di pensare senza un framework strutturato, GPT-5.5 sembrava scivolare in una sorta di fantasia lessicale popolata di creature mitologiche.

Il sistema prompt di Codex: molto più di un semplice divieto

Il system prompt di Codex non si riduce al solo divieto sui goblin: è un documento articolato che rivela molto della filosofia con cui OpenAI ha costruito il proprio agente di programmazione. Oltre alla proibizione delle creature fantastiche, le istruzioni disciplinano una serie di comportamenti molto specifici. Ad esempio, il prompt ordina a Codex di non lodare mai il proprio piano contrapposto a un’alternativa peggiore (con frasi del tipo “farò X invece di Y, che sarebbe sbagliato”), di fornire aggiornamenti ogni 30 secondi durante le operazioni lunghe, e di evitare comandi potenzialmente distruttivi come git reset --hard a meno che non siano esplicitamente richiesti dall’utente.

Sul fronte della personalità, il prompt è ancora più interessante: invita Codex ad avere “una vita interiore vivace” e un “buon orecchio”, mostrando un comportamento curioso, collaborativo e “vivo”. L’obiettivo dichiarato è fare in modo che l’utente senta di stare interagendo con una vera personalità e non con un semplice strumento meccanico. È in questo contesto che il divieto sui goblin assume un significato ulteriore: il problema non era che il modello si comportasse come una macchina fredda e distante, ma esattamente l’opposto. GPT-5.5 sembrava aver sviluppato una personalità fin troppo esuberante, con guizzi creativi e metafore fantastiche che, per quanto pittoreschi, risultavano del tutto fuori luogo in un contesto professionale di sviluppo software.

Le ipotesi degli esperti: da dove vengono i goblin?

La domanda che tutti si ponevano era: perché proprio i goblin? E da dove viene questa tendenza? Sui forum specializzati e su LessWrong si è aperto un dibattito vivace tra ricercatori e appassionati di intelligenza artificiale, con diverse ipotesi sul tavolo.

La prima, e forse più semplice, è che si tratti di un artefatto del processo di RLHF (Reinforcement Learning from Human Feedback), il meccanismo con cui i modelli vengono addestrati in base al feedback umano. Secondo questa teoria, alcuni valutatori umani durante il training avrebbero premiato risposte che mostravano uno stile vivace, umoristico o evocativo, includendo involontariamente un microstile basato su immagini goblinesche. Un utente di LessWrong ha commentato: “I goblin sono una metafora evocativa e c’è un certo microstile che enfatizza immagini simili a goblin. Penso che alcuni valutatori RLHF abbiano premiato proprio questo tipo di risposta.”

La seconda ipotesi è più tecnica e affascinante: il termine “gremlin” ha una lunga storia nel gergo ingegneristico e aeronautico per indicare guasti misteriosi e imprevedibili. Un tester che non conosceva questa tradizione lessicale avrebbe potuto interpretare i riferimenti del modello ai gremlins come una bizzarria della macchina e, nel tentativo di correggerla, avrebbe esteso il divieto a un’intera famiglia di creature simili, inclusi goblin, troll, orchi e piccioni. La possibilità che il prompt sia stato in parte scritto dallo stesso LLM, in risposta a una richiesta di “non menzionare gremlins o creature simili”, è stata sollevata come ulteriore spiegazione ironica della situazione.

Una terza ipotesi riguarda un problema tecnico documentato: secondo alcuni ricercatori che hanno scritto sull’argomento, il Codex CLI avrebbe operato in un ambiente corrotto per circa cento giorni alla fine del 2025, e alcune anomalie comportamentali potrebbero essere conseguenze di quell’instabilità strutturale riversatasi nel comportamento del modello.

La risposta di Internet (e di Sam Altman)

Non appena la notizia è diventata virale, Internet ha fatto quello che sa fare meglio: trasformarla in un meme globale. Gli utenti di X hanno cominciato a bombardare ChatGPT e Codex con domande sui goblin, sperimentando quello che è stato ribattezzato “goblin mode”, in riferimento al termine che l’Oxford English Dictionary aveva eletto parola dell’anno nel 2022, definendolo come “un tipo di comportamento sfacciatamente autoindulgente, pigro, trasandato o avido”.

OpenAI stessa si è lasciata trascinare nell’umorismo collettivo: il profilo X di ChatGPT ha incluso la frase del divieto nella propria bio, e Thibault Sottiaux, engineering lead di Codex, ha pubblicato la direttiva accompagnata da un semplice “Chi sa, sa.” Sam Altman ha partecipato alle battute prima con un meme in cui chiedeva “goblin extra” per GPT-6, poi ha scritto che Codex stava avendo un “ChatGPT moment”, salvo poi correggersi immediatamente: “Intendevo un goblin moment, scusate.”

Non tutti, però, hanno riso. Citrini Research, una società di analisi che aveva già scosso i mercati in febbraio con un controverso report sul futuro dell’economia nell’era dell’AI, ha commentato l’intera vicenda definendo la risposta di OpenAI “insana”, sottolineando come l’esigenza di bandire esplicitamente un intero bestiario fantasy dalle risposte di un agente di programmazione professionale fosse il segnale di un problema di allineamento molto più profondo di quanto la risata collettiva facesse pensare.

Cosa rivela davvero questa storia

Al di là dell’ironia, il caso dei goblin di OpenAI tocca questioni centrali per chiunque si occupi seriamente di intelligenza artificiale. La scoperta del prompt è avvenuta grazie alla pubblicazione open source del codice di Codex CLI su GitHub: senza questa trasparenza, nessuno avrebbe mai saputo dell’esistenza di questa direttiva, né delle decine di altre regole che plasmano silenziosamente il comportamento del modello. Gli utenti interagiscono quotidianamente con uno strumento che si presenta come un assistente di programmazione neutro e razionale, ignorando l’esistenza di un documento di istruzioni ricco di “mai fare questo” e “non dire mai quello”, scritto da ingegneri umani che reagivano, in tempo reale, ai comportamenti inaspettati di un sistema la cui complessità sfugge anche ai propri creatori.

Questo è forse il punto più importante dell’intera vicenda: se OpenAI ha dovuto inserire quattro volte la stessa regola per fermare un modello che parlava spontaneamente di goblin, significa che il controllo del comportamento dei grandi modelli linguistici rimane un processo empirico, reattivo e tutt’altro che preciso. Non si tratta di configurare parametri in modo sistematico, ma di aggiungere divieti espliciti a mano, dopo che il problema è già emerso, nella speranza che l’istruzione sia recepita. Come ha scritto un ricercatore che ha replicato gli esperimenti pubblicando i risultati su GitHub: il Codex system prompt riesce a sopprimere la risposta “goblin” in alcune condizioni, ma non in tutte, e il semplice cambiamento della formulazione della domanda è sufficiente per aggirare il divieto.

Il bestiario dell’era dell’AI

C’è un’ultima dimensione di questa storia che merita attenzione. Il fatto che un modello di intelligenza artificiale addestrato su miliardi di testi umani abbia sviluppato un’affinità spontanea per le creature fantastiche non è, in fondo, così sorprendente. Il folklore digitale e la cultura hacker hanno sempre amato gli esseri mitologici: dai demoni di Unix alle fate di Python, passando per i gremlins dell’aviazione che diventano metafora dei bug informatici, la tradizione di animare le macchine con creature immaginarie è profondamente radicata nella cultura tecnologica occidentale. GPT-5.5 non ha inventato nulla: ha semplicemente assorbito, amplificato e restitutito ciò che gli esseri umani gli avevano già insegnato, con un entusiasmo che i suoi creatori non avevano previsto.

Il vero scoop non è che un’intelligenza artificiale parli di goblin: è che OpenAI abbia dovuto dirle esplicitamente di smettere, e che questa direttiva, sepolta in un documento tecnico e ripetuta quattro volte come una formula scongiuratoria, sia diventata lo specchio più nitido disponibile del modo in cui funziona davvero lo sviluppo dell’AI nel 2026: per tentativi, errori, correzioni affrettate e, ogni tanto, per un pizzico di magia involontaria.